Investigación autónoma: lo que autoresearch revela

Ricardo Argüello — 8 de marzo de 2026

CEO & Fundador

Resumen general

Karpathy publicó autoresearch: 630 líneas de código donde un agente modifica, entrena y evalúa modelos en un loop autónomo — 12 experimentos por hora, 100 por noche. Su siguiente paso, enjambres de agentes colaborativos al estilo SETI@home, anticipa cambios reales en cómo las empresas organizan el trabajo técnico.

- Un agente autónomo ejecuta 100 experimentos por noche usando git como memoria — sin intervención humana

- El patrón iterar-probar-evaluar ya se aplica a procesos de negocio con métricas claras

- Karpathy proyecta enjambres de agentes colaborativos que exploran soluciones en paralelo

- Funciona mejor donde hay una métrica única y medible; los trade-offs estratégicos todavía requieren juicio humano

- Las industrias reguladas necesitan registros de auditoría que expliquen el razonamiento, no solo los resultados

Imagina que le dejas instrucciones a un asistente antes de irte a dormir, y al despertar tiene 100 experimentos terminados con los mejores resultados marcados. Eso es lo que hizo Karpathy con un programa de solo 630 líneas: el agente prueba ideas, descarta las que no funcionan y conserva las que sí — todo solo. El patrón ya se puede aplicar a tareas de negocio donde el éxito se mide con números claros.

Resumen generado con IA

Karpathy publicó un repositorio que ejecuta investigación de IA mientras él duerme. No como metáfora — literalmente configura un archivo, se va a dormir, y al amanecer tiene 100 experimentos completados con resultados rankeados.

Para quien no lo ubique: Andrej Karpathy fue Director de IA en Tesla (lideró la visión de Autopilot), miembro fundador de OpenAI, PhD de Stanford, y ahora fundador de Eureka Labs. Cuando publica algo, no es un proyecto casual de fin de semana. Es una señal de hacia dónde se mueve la industria.

Cloné el repo y leí el código. Son 630 líneas. Eso es todo. Y lo que hacen esas 630 líneas es más interesante que la mayoría de los papers de investigación que he leído este año. Pero lo importante no es el código en sí — es el patrón que demuestra. Loops autónomos de iteración-prueba-evaluación que ya se aplican a operaciones de negocio.

Qué hace autoresearch (en concreto)

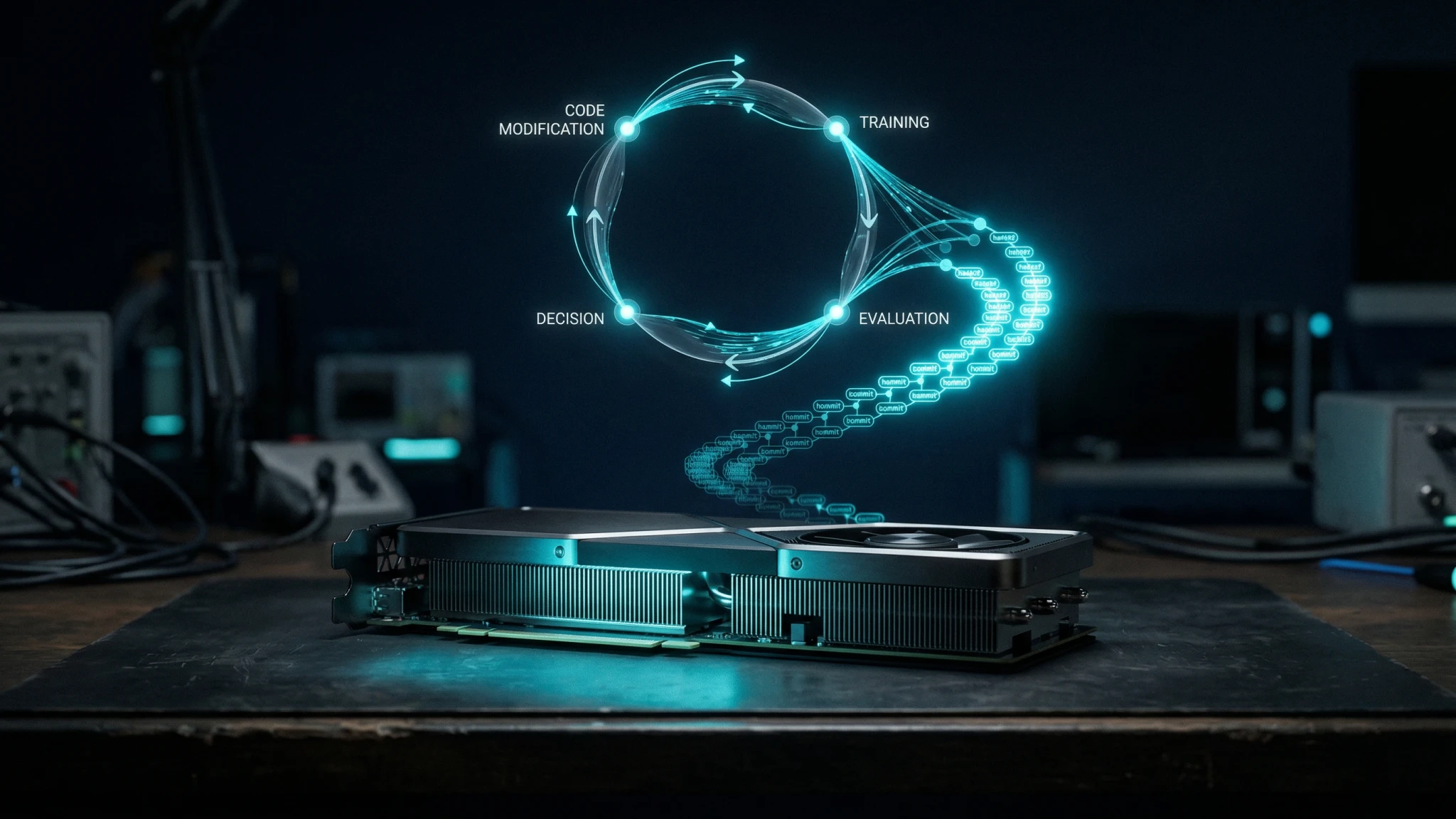

El flujo es directo. El humano escribe un archivo llamado program.md — instrucciones de alto nivel sobre qué investigar. El agente toma esas instrucciones, modifica train.py, entrena un modelo durante 5 minutos, evalúa la pérdida de validación (val_bpb), decide si el cambio mejoró o empeoró el resultado, y repite. Sin intervención humana.

Los números: ~12 experimentos por hora. ~100 en una noche. Cada uno es una corrida completa de entrenamiento de un LLM.

Lo elegante es cómo usa git como memoria. Cada experimento es un commit en una feature branch. Si el resultado mejora, el commit se conserva. Si empeora, se descarta. El historial de git se convierte en un registro completo de qué funcionó y qué no — sin necesidad de bases de datos, dashboards, ni herramientas externas.

Todo corre en una sola GPU. Es autocontenido. Como dijo Karpathy: “Part code, part sci-fi, and a pinch of psychosis.”

El repositorio está en GitHub y es open-source.

El patrón que importa: iterar sin esperar

Si abstraes lo que hace autoresearch, el patrón es: definir objetivo → agente intenta soluciones → medir contra métrica → conservar o descartar → repetir.

Ese patrón ya existe en todas las empresas. Lo que cambia es quién está en cada parte del loop. Hoy, los humanos están en el loop de iteración — probando configuraciones, ajustando parámetros, ejecutando pruebas, revisando resultados. Eso es cuello de botella. No por falta de capacidad, sino porque un humano hace una cosa a la vez y necesita dormir.

Lo que demuestra autoresearch es una separación limpia: el humano se queda en el loop de dirección — define qué investigar, qué restricciones aplicar, qué métricas importan. El agente se queda en el loop de iteración — ejecuta, mide, decide, repite. Karpathy escribe program.md; el agente hace todo lo demás.

Esto es exactamente lo que vemos en la función de operador de agentes que ya estamos implementando con clientes. El humano no desaparece — cambia de posición. Pasa de ejecutar a dirigir.

En un proyecto reciente, configuramos un agente de validación de datos que probó 40 reglas de extracción diferentes durante la noche. El equipo llegó a la mañana siguiente con una lista rankeada de las que mejor funcionaban. Lo que habría tomado una semana de prueba-error manual se resolvió en 8 horas sin supervisión.

De un agente a un enjambre

Pero Karpathy no se detuvo en un solo agente iterando. Su siguiente publicación plantea algo más ambicioso: enjambres de agentes colaborativos al estilo SETI@home. No un estudiante de PhD virtual, sino una comunidad de investigación de agentes.

La idea: muchos agentes trabajando de forma asíncrona en problemas compartidos. En vez de un loop individual, múltiples agentes adoptan ramas distintas, acumulan miles de commits, y exploran el espacio de soluciones más rápido que cualquier agente solo.

La cita que me quedó: “Existing abstractions will accumulate stress as intelligence, attention and tenacity cease to be bottlenecks.” Es decir — las herramientas y procesos que usamos fueron diseñados para velocidad humana. Cuando esa restricción desaparece, las herramientas se rompen.

El ejemplo concreto: el diseño de GitHub asume flujos humanos. Master → branch → merge → review. Un agente que produce miles de commits en estructuras arbitrarias no encaja en ese flujo. Las abstracciones se tensan.

El paralelo empresarial es directo. Las cadenas de aprobación, los procesos de QA, los ciclos de reporting — todos asumen que el output llega a velocidad humana. Si un agente produce resultados a 12 por hora, necesitas revisión por lotes, validación estadística, y gates de calidad automatizados. No puedes revisar 100 experimentos uno por uno al estilo de un PR de código.

Y esto no es una predicción a 5 años. autoresearch funciona hoy. La capa colaborativa es lo siguiente.

Lo que todavía no funciona

Hay que ser honestos. autoresearch optimiza una métrica estrecha y limpia: val_bpb (pérdida de validación en bits por byte). Un número que baja = mejor. No hay ambigüedad.

La mayoría de problemas de negocio no tienen una sola métrica limpia. “Mejorar satisfacción del cliente” no es val_bpb. “Reducir costos operativos” involucra trade-offs entre calidad, velocidad y cumplimiento que un agente no puede resolver solo.

Los agentes carecen de juicio estratégico. Optimizan la métrica que les das, pero no entienden por qué esa dirección importa. Un agente que reduce costos de extracción de datos un 30% pero introduce errores en campos regulados no resolvió nada — creó un problema nuevo.

Y en industrias reguladas, el “qué cambió” (un diff de git) no basta. Necesitas explicar por qué se hizo cada cambio y qué riesgos se evaluaron. Eso todavía requiere humanos.

Qué significa para tu operación

La iteración autónoma ya es viable para problemas bien definidos. Si tienes un proceso con una métrica clara — precisión de órdenes, tasa de extracción, tiempo de respuesta — un agente puede iterar durante la noche. No necesitas 630 líneas de código ML. Necesitas un loop claro: intentar → medir → decidir → repetir.

El modelo de “dirección + restricciones” es cómo se despliegan agentes hoy. El program.md de Karpathy es la plantilla. Define qué quieres lograr y qué está fuera de límites. El agente ejecuta dentro de esos bordes. Esto es exactamente lo que describimos en la guía de agentes para operaciones empresariales — la diferencia entre un agente útil y uno peligroso está en la calidad de las restricciones.

Tus herramientas no fueron diseñadas para iteración a velocidad de agente. 100 experimentos por noche significa que tu control de versiones, flujos de aprobación, y monitoreo necesitan manejar ese volumen. No puedes hacer review manual de cada resultado. Necesitas estructuras organizativas que asuman output continuo, no entregas discretas.

Karpathy incluyó un párrafo que suena a ciencia ficción — sobre “computadoras de carne” que programan agentes que ejecutan investigación. Suena a ficción, pero autoresearch es el primer párrafo de esa historia siendo escrito hoy.

La implicación para las empresas no es “la IA reemplaza a todos.” Es que las empresas que descubran cómo dirigir loops de iteración autónoma — con métricas claras, buenas restricciones, y supervisión humana a nivel estratégico — van a operar a una velocidad diferente. Las que sigan esperando a que cada ciclo pase por manos humanas van a competir contra organizaciones que iteran 12 veces por hora.

Si ya tienes un proceso con una métrica clara y un ciclo de iteración manual, ese es tu candidato. En IQ Source, definimos el equivalente de tu program.md y configuramos el loop. Agenda una sesión de 60 minutos y lo mapeamos juntos.

Preguntas Frecuentes

Es un repositorio open-source de unas 630 líneas donde un agente de IA modifica código de entrenamiento de forma autónoma, ejecuta experimentos de 5 minutos, evalúa la pérdida de validación y decide si conserva o descarta cada cambio. Corre unos 12 experimentos por hora — cerca de 100 en una noche — usando un solo GPU.

Sí, para procesos con métricas claras y medibles: precisión de extracción de datos, tasas de error, clasificación de documentos. El agente itera durante la noche y presenta opciones rankeadas para revisión humana al día siguiente. Procesos sin métricas limpias todavía necesitan juicio humano en el loop.

Es la visión de Karpathy donde muchos agentes trabajan de forma asíncrona en problemas compartidos, como un SETI@home para investigación. En vez de un solo agente iterando, múltiples agentes adoptan ramas diferentes, acumulan miles de commits y exploran el espacio de soluciones más rápido que cualquier agente individual.

Funciona mejor con una métrica única y clara. La mayoría de problemas de negocio involucran trade-offs entre costo y calidad, velocidad y cumplimiento. Los agentes carecen de juicio estratégico sobre por qué una dirección importa, y las industrias reguladas necesitan registros de auditoría que expliquen el razonamiento, no solo los diffs.

Artículos Relacionados

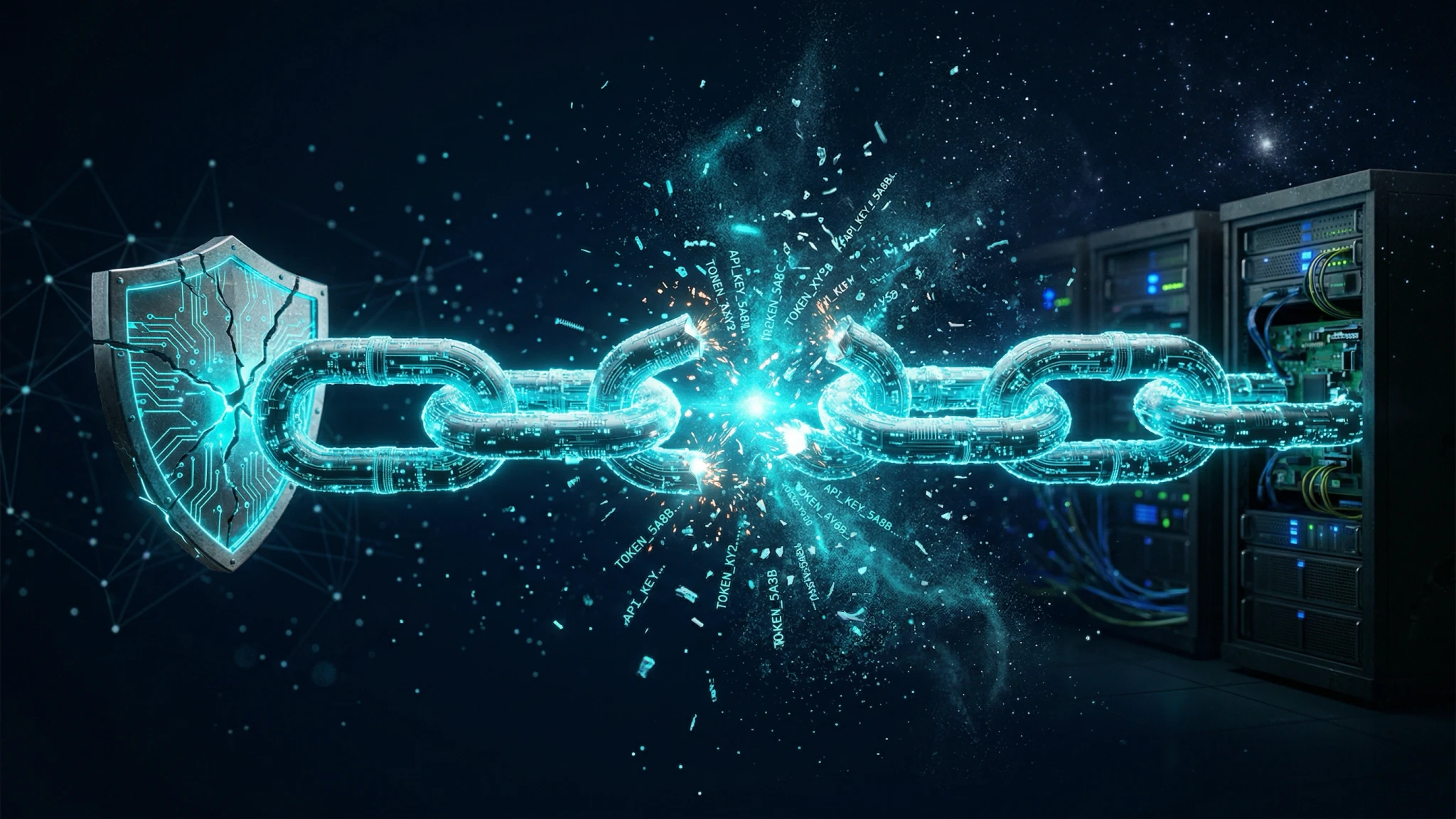

Ataque a LiteLLM: tu cadena de confianza de IA, rota

LiteLLM, el proxy de API keys de IA con 97 millones de descargas mensuales, fue envenenado vía PyPI. Tu escáner de seguridad fue el vector de entrada.

Google Stitch y AI Studio: diseño y código sin ingenieros

Google lanzó un pipeline completo de diseño a producción con Stitch y AI Studio. Qué sirve para prototipos B2B y dónde necesitas ingeniería real.