Tu agente de IA es gratis. Desplegarlo en producción, no.

Ricardo Argüello — 13 de marzo de 2026

CEO & Fundador

Resumen general

Cada semana un cliente nos manda un link a un framework open-source de agentes de IA. El código es gratis y funciona. El problema empieza cuando quieres desplegarlo en producción con seguridad, monitoreo y alguien que conteste a las 2 AM. Es el mismo patrón de Heroku con Rails, Vercel con Next.js — la herramienta es gratuita, pero la infraestructura no.

- Los frameworks open-source de agentes de IA tienen una barrera de despliegue que excluye a los equipos B2B que más se beneficiarían

- El patrón Heroku se repite: toda herramienta open-source que requiere configuración de servidor termina con una capa gestionada encima

- Las plataformas gestionadas resuelven el síntoma (complejidad de despliegue) pero no la causa raíz (falta de expertise en infraestructura)

- La pregunta real no es auto-hospedar vs. plataforma gestionada — es quién controla tu infraestructura de IA y qué pasa cuando algo falla

Imagina que te regalan un auto deportivo. Gratis, llave en mano. Pero necesitas construir tu propio garaje, tu propia gasolinera, y contratar un mecánico que esté disponible cuando se descomponga a medianoche. El auto no te costó nada — todo lo demás sí. Eso es exactamente lo que pasa con los frameworks open-source de agentes de IA: el código es gratis, pero ponerlo a funcionar en tu empresa requiere infraestructura, seguridad y soporte que alguien tiene que construir.

Resumen generado con IA

Cada semana nos llega el mismo mensaje: un link a un framework open-source de agentes de IA, seguido de “Es gratis, ¿por qué pagaríamos por algo que ya existe?”

El framework funciona. Corre perfecto en localhost. El README lleva de cero a docker-compose up en 15 minutos. Los tests pasan.

Y después alguien intenta conectarlo a un Active Directory corporativo, gestionar API keys de cinco proveedores de IA distintos, y garantizar que los datos de clientes no salgan de la región. Ahí se acaba lo gratis.

Es el mismo patrón que la industria de software repite desde hace 20 años — ahora le toca a los agentes de IA.

El patrón que ya conoces (si recuerdas Heroku)

En 2007, Ruby on Rails era gratis y transformó el desarrollo web. Pero desplegarlo en producción requería saber configurar servidores Linux, balanceadores de carga, bases de datos en cluster. Heroku apareció con git push heroku main y cobró por eliminar esa fricción.

El mismo ciclo se repitió: Next.js → Vercel, sitios estáticos → Netlify, Terraform → HCP después del cambio de licencia de HashiCorp. El patrón tiene tres fases: una herramienta open-source gana tracción, los equipos empresariales descubren que la instalación básica no alcanza para producción, y alguien construye una capa gestionada que cobra por resolver la complejidad.

Ahora está pasando con los frameworks de agentes de IA. Aakash Gupta lo identificó esta semana: OpenClaw, un framework open-source de agentes, requiere Node.js 18+, Docker, gestión de API keys de múltiples proveedores, y hardening de servidor. FlashClaw apareció ofreciendo despliegue con un click.

No es solo OpenClaw. CrewAI, AutoGen, LangGraph — todos tienen la misma brecha entre “funciona en mi laptop” y “funciona en producción con las políticas de seguridad de mi empresa”. CrowdStrike ha documentado instancias de agentes mal configuradas que se convierten en superficies de ataque — el canario en la mina de esta tendencia.

Si aún estás evaluando QUÉ pueden hacer los agentes para tu operación, empieza con nuestra guía de agentes para operaciones empresariales. Este artículo asume que ya decidiste usarlos y pregunta: ¿cómo los despliegas?

Lo que el README no te dice sobre producción

Cada framework de agentes viene con un README que te lleva de cero a “funciona” en 15 minutos. Lo que no incluye es lo que pasa después:

| Lo que descargas | Lo que producción requiere |

|---|---|

docker-compose.yml | Orquestación de contenedores con health checks y restart policies |

.env.example | Gestión de secretos con rotación automática y auditoría |

| Testing en localhost | TLS terminado, firewalls configurados, protección DDoS |

| Modo single-user | Aislamiento multi-tenant con control de acceso |

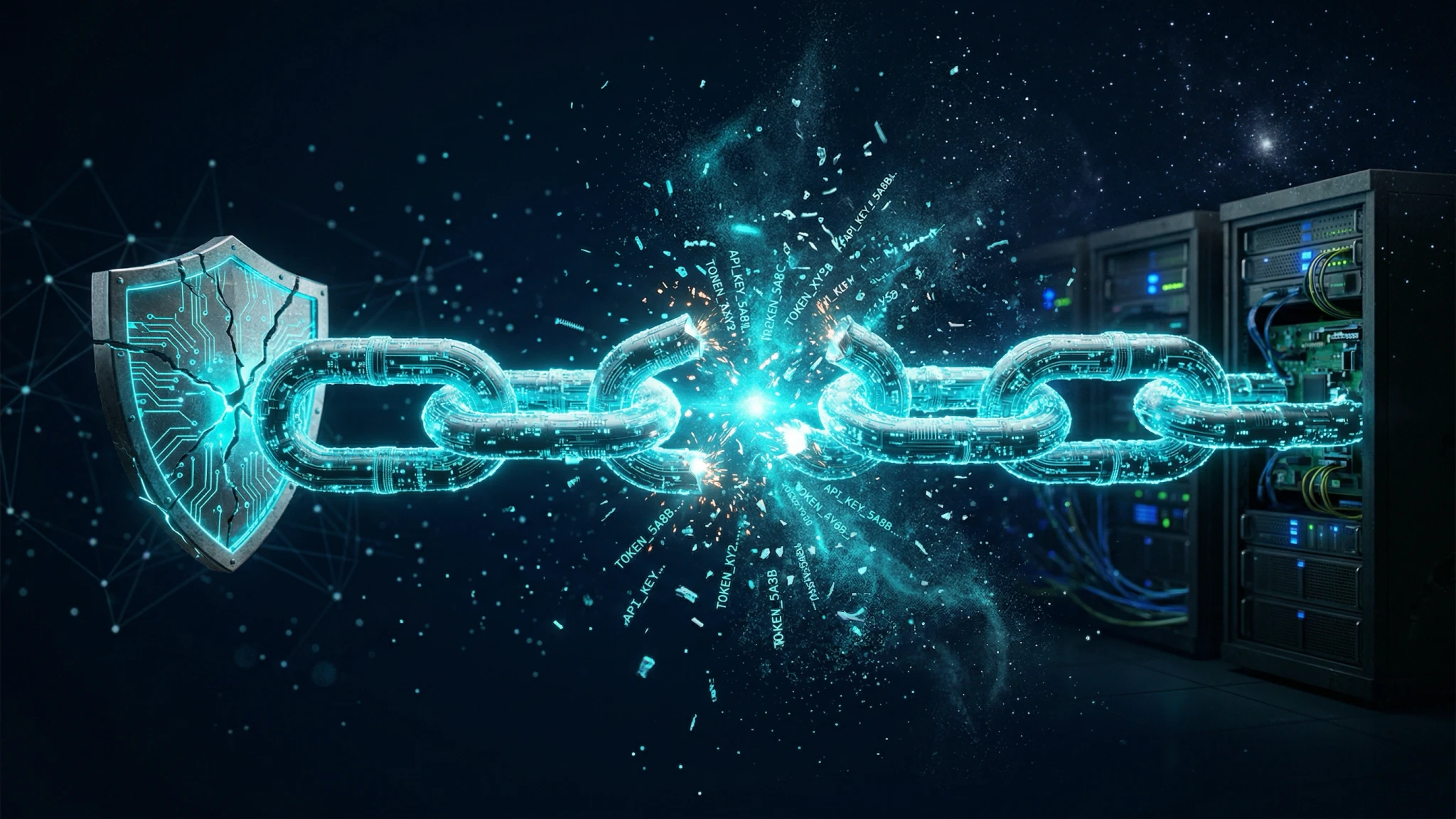

Las API keys son el nuevo perímetro de ataque

Un framework de agentes conectado a 5 o 10 proveedores de IA significa 5 o 10 conjuntos de API keys, cada uno con políticas de rotación, límites de tasa y modelos de facturación distintos. OpenAI rota diferente que Anthropic, que rota diferente que Cohere.

En nuestra experiencia, ~80% de los equipos que evaluamos almacenan estas keys en archivos .env sin cifrado ni rotación. Un solo archivo comprometido expone acceso a todos los proveedores simultáneamente — con el agravante de que las keys de IA suelen tener acceso a modelos que procesan datos sensibles.

La lista OWASP Top 10 para aplicaciones LLM ya incluye la gestión inadecuada de credenciales como vector de ataque prioritario.

El agente que funciona en tu laptop no funciona a las 2 AM

En tu laptop, si un proveedor de IA falla, reinicias el proceso. En producción a las 2 AM, necesitas monitoreo que detecte la caída, alertas que notifiquen al equipo correcto, lógica de fallback que cambie a un proveedor alternativo, y logs suficientes para diagnosticar qué pasó al día siguiente.

Nada de eso viene con el framework. Monitoreo, alertas, auto-restart, degradación controlada cuando un proveedor cae — todo eso lo construyes tú. O no lo construyes, y lo descubres cuando algo falla en el peor momento posible.

Tres caminos, tres tradeoffs

Hay tres opciones. Ninguna es universalmente correcta.

Auto-hospedaje: control total, costo total

Tiene sentido cuando tu equipo incluye ingenieros de plataforma dedicados, cuando regulaciones te obligan a mantener todo on-premise, o cuando necesitas personalización profunda del framework.

El costo real no son los servidores — son las personas. El State of DevOps Report de Puppet documenta consistentemente que los equipos de ingeniería dedican ~35% de su tiempo a tareas de infraestructura en vez de desarrollo de producto. Agregar un framework de agentes a esa carga la incrementa sin agregar capacidad al equipo.

Siendo honestos: de los últimos 50 clientes que han evaluado agentes de IA con nosotros, quizás 3 genuinamente necesitaban auto-hospedar. Los otros 47 creían que lo necesitaban porque no conocían las alternativas.

Plataformas gestionadas: velocidad con letra chica

FlashClaw, LangSmith, y varias plataformas de agent-as-a-service resuelven la fricción de despliegue de forma inmediata. Subes tu configuración, conectas tus proveedores, y en 20 minutos tienes un agente corriendo. El time-to-value es real.

La letra chica:

Residencia de datos. ¿Dónde van tus prompts y las respuestas de tus agentes? Si tu empresa maneja datos de clientes latinoamericanos sujetos a regulaciones de privacidad locales, esta pregunta no es opcional.

Dependencia del proveedor. Las capas de orquestación propietarias que hacen fácil el despliegue también hacen difícil la migración. Tu configuración de agentes vive en su formato, en su infraestructura, bajo sus términos. El día que quieras cambiar de plataforma, descubres que tu lógica de agentes está atada a sus abstracciones.

Precios. Un cliente empezó pagando $180 al mes en piloto. Seis meses después, procesando volúmenes reales, la factura llegó a $4,200. El modelo funciona hasta que escala.

Partner técnico: alguien que entiende tu infraestructura

La tercera opción que la mayoría de empresas no considera: un partner técnico que despliega la herramienta open-source en TU infraestructura, configurada según TUS políticas de seguridad, y que está disponible cuando algo falla.

El trimestre pasado desplegamos un framework open-source de agentes para un cliente de logística en Centroamérica. La instalación del framework en sí tomó 2 horas. La configuración de seguridad, monitoreo e integración con su Azure AD existente tomó 3 semanas. Esa proporción — horas de instalación versus semanas de hardening — es consistente en cada proyecto que hemos hecho.

Si además estás evaluando qué proveedores de IA conectar a tus agentes, nuestro framework de selección de proveedores cubre el lado de gobernanza de datos.

La pregunta que nadie hace

La discusión habitual se centra en “auto-hospedar vs. plataforma gestionada”. Pero eso es debatir el síntoma, no la causa.

La pregunta real es: ¿quién controla tu infraestructura de IA, y qué pasa cuando algo falla a las 2 AM?

Las plataformas gestionadas resuelven el despliegue. No resuelven que nadie en tu equipo sepa qué hacer cuando el agente falla a las 2 AM.

Antes de elegir camino, responde estas cuatro preguntas:

- ¿Tu equipo puede configurar orquestación de contenedores con health checks y restart automático?

- ¿Tienen un sistema de gestión de secretos con rotación y auditoría, o usan archivos

.env? - ¿Existe monitoreo con alertas configuradas para los servicios que corren tus agentes?

- ¿Hay un runbook de respuesta a incidentes para cuando un proveedor de IA cae o un agente produce resultados incorrectos?

Si tu equipo responde sí a las cuatro, probablemente puede auto-hospedar.

Si no pueden responder tres de cuatro, necesitan ayuda — ya sea una plataforma gestionada o un partner técnico. La diferencia entre las dos opciones: la plataforma gestionada es dueña de tu stack. Un partner técnico hace que tú seas dueño.

Lo que hacemos cuando un cliente nos trae un framework open-source de agentes

La mayoría de los clientes que llegan hasta aquí nos preguntan lo mismo: “¿qué pasa si les mando el link?” Así funciona:

Auditoría de seguridad de la configuración de despliegue. Revisamos el Dockerfile, el docker-compose.yml, y cualquier script de infraestructura. ¿Los contenedores corren como root? ¿Hay puertos expuestos innecesariamente? ¿Las imágenes base están actualizadas?

Diseño de gestión de API keys. Reemplazamos el .env.example con un sistema real: vault para secretos, rotación programada, y principio de menor privilegio por proveedor.

Configuración de monitoreo y alertas. Conectamos el framework a la infraestructura de observabilidad existente del cliente. Métricas de salud del agente, latencia de respuesta, tasa de errores por proveedor, costos acumulados por día.

Runbook de incidentes. Documentamos qué hacer cuando cada componente falla: proveedor de IA caído, agente atascado en loop, costos que se disparan por un prompt mal configurado.

Handoff al equipo del cliente. Transferimos todo — código, configuración, conocimiento. El cliente es dueño de su infraestructura. Nosotros quedamos disponibles para soporte, pero la propiedad es suya.

Escribimos sobre evaluar la CALIDAD DEL CÓDIGO de herramientas open-source aquí. Este es el otro lado: evaluar la preparación para el DESPLIEGUE.

Si ahora mismo tienes un docker-compose.yml de un framework de agentes de IA abierto en una pestaña y te preguntas cómo llevarlo a producción con las políticas de seguridad de tu empresa, esa es exactamente la conversación que tenemos cada semana. Mándanos el link al repo — te decimos cómo se ve el despliegue para tu entorno específico.

Preguntas Frecuentes

El patrón Heroku describe un ciclo recurrente en tecnología: una herramienta open-source gana popularidad pero requiere conocimientos de servidor para desplegarse, y eventualmente aparece una plataforma gestionada que cobra por eliminar esa fricción. Pasó con Rails y Heroku, con Next.js y Vercel, y ahora pasa con frameworks de agentes de IA. El código es gratis; la infraestructura para correrlo en producción no.

Puede serlo, pero requiere trabajo significativo más allá de la instalación. Necesitas gestión de secretos con rotación automática, contenedores aislados, monitoreo con alertas, firewalls configurados, y un plan de respuesta a incidentes. Si tu equipo no tiene experiencia en DevOps y seguridad de contenedores, el auto-hospedaje multiplica el riesgo en vez de reducirlo.

Una plataforma gestionada aloja tu agente en su infraestructura: despliegue rápido, pero tus datos pasan por sus servidores y quedas atado a sus precios y políticas. Un partner técnico despliega el agente en tu infraestructura, configurado según tus políticas de seguridad, y te transfiere el control. La diferencia clave: con la plataforma, ellos son dueños del stack. Con un partner, tú eres dueño.

El framework es gratis, pero el despliegue a producción típicamente cuesta entre $5,000 y $25,000 USD dependiendo de la complejidad. Eso incluye seguridad de contenedores, gestión de API keys, monitoreo, e integración con sistemas existentes. En nuestra experiencia, la instalación del framework toma horas; la configuración de seguridad e integración toma semanas.

Artículos Relacionados

Ataque a LiteLLM: tu cadena de confianza de IA, rota

LiteLLM, el proxy de API keys de IA con 97 millones de descargas mensuales, fue envenenado vía PyPI. Tu escáner de seguridad fue el vector de entrada.

Google Stitch y AI Studio: diseño y código sin ingenieros

Google lanzó un pipeline completo de diseño a producción con Stitch y AI Studio. Qué sirve para prototipos B2B y dónde necesitas ingeniería real.