Ecosistema de IA de Google: qué sirve y qué no para B2B

Ricardo Argüello — 1 de marzo de 2026

CEO & Fundador

Resumen general

Google tiene más de 25 productos de IA, muchos con funcionalidades solapadas y un historial de renombrar o descontinuar servicios con poco aviso. Para una empresa B2B, la primera pregunta no es cuál usar sino cómo no perder tres meses en la evaluación.

- El ecosistema se divide en tres capas con niveles de control y portabilidad distintos

- Si ya estás en GCP, Vertex AI tiene sentido; si no, el API directo de Gemini evita lock-in innecesario

- Google ha renombrado o descontinuado múltiples productos de IA en tres años (PaLM, Bard, AutoML Tables)

- La mejor estrategia para la mayoría de empresas B2B es multi-proveedor: cada modelo donde más rinde

- Aislar integraciones detrás de capas de abstracción es la defensa contra cambios de producto sin aviso

Imagina que entras a una tienda con 25 productos parecidos, algunos hacen lo mismo con distinto nombre, y el dueño tiene fama de cambiar los nombres o sacar productos de la estantería sin avisar. Eso es el ecosistema de IA de Google para una empresa que quiere adoptar sus herramientas. No todo es malo — hay productos excelentes — pero necesitas un mapa claro para no perder meses evaluando opciones que se solapan o que podrían desaparecer.

Resumen generado con IA

Google tiene demasiadas herramientas de IA — y eso es un problema

Abre la consola de Google Cloud y cuenta: Vertex AI, Gemini API, BigQuery ML, Document AI, AutoML, Dialogflow, Contact Center AI, Healthcare AI, Retail AI, Vision AI, Natural Language AI, Translation AI, Speech-to-Text, Text-to-Speech…

Son más de 25 productos relacionados con IA, muchos con funcionalidades que se solapan.

Para una empresa B2B que evalúa adoptar IA de Google, la primera pregunta no es “¿cuál uso?” sino “¿por dónde empiezo sin perder tres meses en la evaluación?”

El problema se agrava porque Google tiene un historial de renombrar y descontinuar productos de IA — o fusionarlos sin aviso — con una frecuencia que genera desconfianza. PaLM se convirtió en Gemini. Bard se convirtió en Gemini. AutoML Tables ahora es parte de Vertex AI. Cada cambio de nombre significa documentación desactualizada, migraciones forzadas y riesgo para las empresas que ya implementaron la versión anterior.

Este artículo es un mapa honesto. No es una guía de ventas de Google — es una evaluación práctica de qué sirve, qué no, y dónde están las trampas.

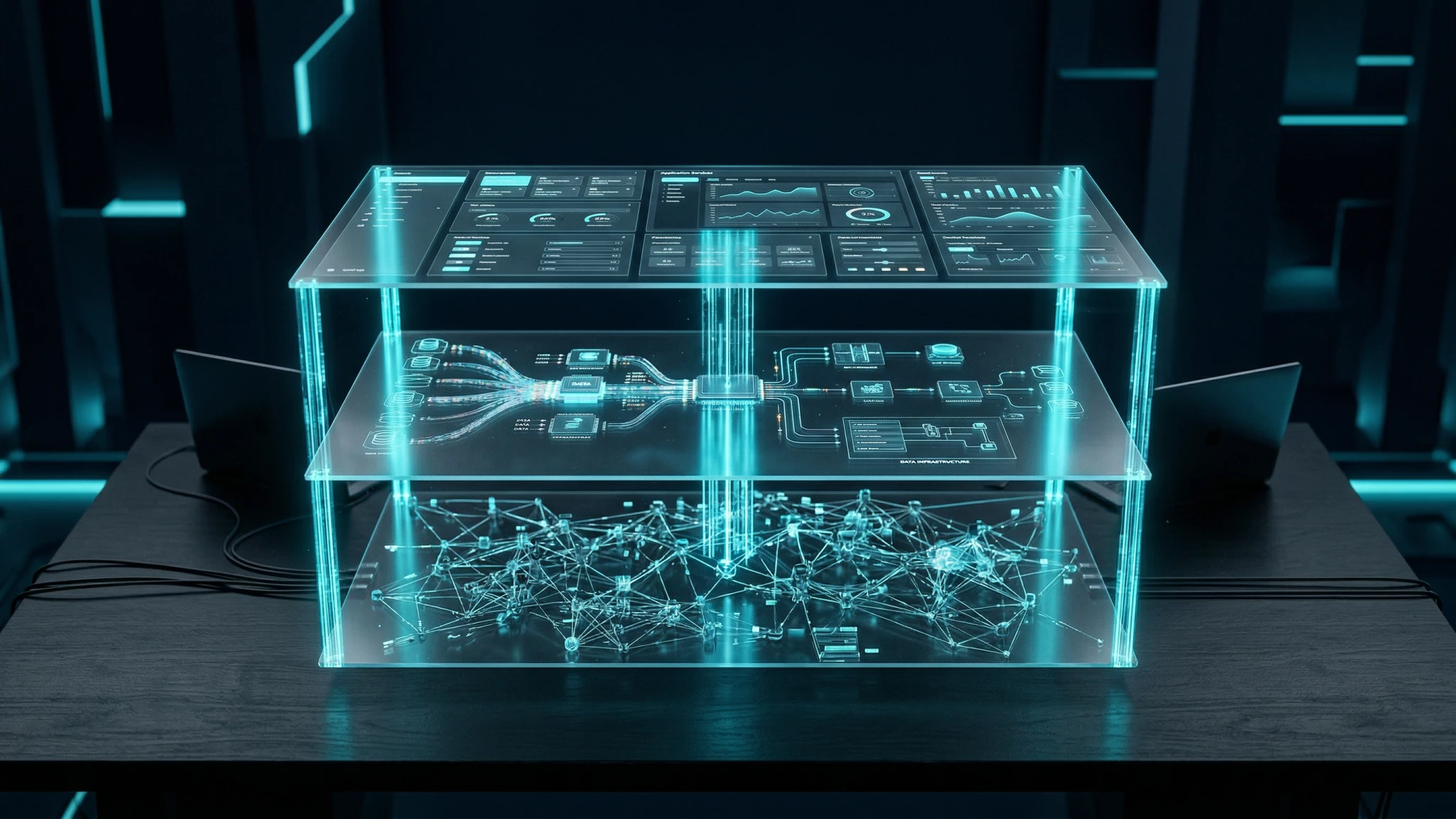

Las tres capas del ecosistema de IA de Google

Para entender el ecosistema sin perderse, conviene dividirlo en tres capas según el nivel de control que ofrecen.

Capa 1: Modelos fundacionales — Gemini

Gemini es la familia de modelos de Google, disponibles en tres tiers:

- Gemini Flash: el modelo rápido y económico. Ideal para clasificación, extracción de datos y tareas de alto volumen donde la latencia importa más que la sofisticación

- Gemini Pro: el modelo de propósito general. Bueno para generación de contenido, análisis de documentos y razonamiento sobre datos con contextos de hasta 2M de tokens

- Gemini Ultra: el modelo más capaz. Para tareas complejas de razonamiento, análisis multimodal avanzado y problemas que requieren múltiples pasos de inferencia

La fortaleza real de Gemini frente a la competencia es su capacidad multimodal nativa. No es un modelo de texto al que le agregaron visión como parche — puede procesar texto, imágenes, audio y video dentro de la misma llamada API. Para empresas que trabajan con documentos escaneados, video de seguridad o audio de call centers, esto simplifica la arquitectura considerablemente.

Donde Gemini se queda corto: en nuestra experiencia, el seguimiento de instrucciones complejas y la precisión en tareas que requieren razonamiento paso a paso todavía no están al nivel de Claude en varios escenarios empresariales. Y el historial de cambios abruptos de Google (descontinuar modelos con poco aviso) genera incertidumbre legítima sobre estabilidad a largo plazo.

Capa 2: Servicios de plataforma — Vertex AI y compañía

Aquí es donde Google agrega valor por encima del modelo:

- Vertex AI: la plataforma de orquestación. Permite desplegar modelos, crear pipelines de datos, hacer fine-tuning, y monitorear inferencias. Es el equivalente de Google a Amazon SageMaker o Azure ML

- BigQuery ML: machine learning directamente desde SQL. Si tus datos ya están en BigQuery, puedes entrenar modelos de clasificación, regresión y clustering sin mover datos ni cambiar de herramienta

- Document AI: extracción estructurada de documentos. Facturas, contratos, formularios — los convierte en datos estructurados con modelos pre-entrenados o personalizados

Capa 3: Soluciones pre-construidas

Son productos verticales que Google empaqueta para industrias específicas:

- Contact Center AI: automatización de call centers con agentes conversacionales

- Healthcare AI: análisis de imágenes médicas y datos clínicos

- Retail AI: personalización de productos y previsión de demanda

El problema con esta capa: máximo lock-in, mínima portabilidad. Si adoptas Contact Center AI y luego quieres migrar, básicamente empiezas de cero. Los datos, los flujos y las integraciones son propietarios.

Comparativa rápida entre capas

| Criterio | Capa 1: Modelos (Gemini) | Capa 2: Plataforma (Vertex AI) | Capa 3: Soluciones verticales |

|---|---|---|---|

| Control | Alto — elige modelo y configura | Medio — Google maneja infra | Bajo — caja negra |

| Riesgo de lock-in | Bajo si usas API directo | Medio — pipelines atados a GCP | Alto — migración costosa |

| Tiempo a producción | Semanas | 1-3 meses | 2-6 meses |

| Costo mensual típico | $500 - $5,000 | $2,000 - $20,000 | $10,000+ |

| Equipo requerido | Desarrolladores con experiencia en APIs | Ingenieros de ML + DevOps | Implementadores certificados |

Dónde Google tiene ventaja real — y dónde no

Donde Google gana

BigQuery ML para empresas que ya están en BigQuery. Si tus datos de negocio ya viven en BigQuery — y para muchas empresas B2B que migraron a GCP en los últimos 5 años, es el caso — BigQuery ML elimina la fricción de mover datos a otra plataforma para hacer machine learning. Entrenas modelos con SQL, los resultados se quedan donde están tus datos. Simple y efectivo.

Document AI para extracción estructurada de documentos. Hemos implementado Document AI en proyectos con nuestros clientes para procesar facturas, órdenes de compra y contratos. La precisión en documentos semi-estructurados (PDFs con tablas, formularios escaneados) es consistentemente buena, especialmente con los modelos pre-entrenados para tipos de documentos estándar.

Gemini Flash para tareas de alto volumen y bajo costo. Para clasificación de correos, extracción de entidades, y categorización de contenido a escala, Flash ofrece la mejor relación costo/rendimiento del mercado. En un proyecto con un cliente de e-commerce, el costo por documento procesado con Flash fue ~40% menor que con modelos comparables de otros proveedores.

Grounding con Google Search. La capacidad de conectar las respuestas de Gemini con resultados actualizados de Google Search es única. Para aplicaciones que necesitan información factual en tiempo real — pricing de competidores, noticias de industria, datos regulatorios — esto agrega una capa de verificación que otros proveedores no tienen.

Donde Google no gana

Historial de estabilidad de productos. Este es el elefante en la habitación. Google ha descontinuado, renombrado o fusionado más productos de IA en los últimos tres años que cualquier otro proveedor. El cementerio de productos de Google es largo y documentado. Para una empresa que planea una inversión de 12-24 meses en integración, esta inestabilidad es un riesgo real.

Soporte empresarial. Comparado con la experiencia de soporte de Azure (con equipos de cuenta dedicados) o incluso de Anthropic (con soporte técnico directo para clientes enterprise), el soporte de Google Cloud todavía se siente transaccional. Cuando tienes un problema en producción a las 2 AM, la diferencia importa.

Razonamiento complejo y seguimiento de instrucciones. Para tareas que requieren razonamiento multi-paso, análisis de documentos legales extensos, o seguimiento preciso de instrucciones complejas, Gemini Pro todavía tiene brechas comparado con los mejores modelos de la competencia. Mejora con cada versión, pero la brecha existe.

El factor “ya estoy en GCP”

Aquí hay que ser honestos: si tu empresa ya opera en Google Cloud Platform, el ecosistema de IA de Google tiene ventajas que ningún competidor puede igualar. La integración nativa con tus datos en BigQuery, tus buckets en Cloud Storage, tus redes en VPC — todo fluye sin configuración adicional.

Pero si no estás en GCP, esas ventajas desaparecen. Y la migración a GCP solo por las herramientas de IA rara vez se justifica.

El riesgo de lock-in en el ecosistema de Google

El lock-in con Google opera en cuatro niveles:

Nivel 1 — Datos: BigQuery ML requiere que tus datos estén en BigQuery. Document AI procesa documentos almacenados en Cloud Storage. Vertex AI Pipelines lee datasets de GCP. Mover tus datos a otro proveedor tiene un costo real en tiempo, transferencia y re-procesamiento.

Nivel 2 — Pipelines: Los pipelines de Vertex AI están escritos en formato propietario de Google. No puedes exportar un pipeline de Vertex AI y ejecutarlo en AWS SageMaker o Azure ML sin reescribirlo.

Nivel 3 — Modelos entrenados: Si haces fine-tuning de un modelo en Vertex AI, ese modelo se queda en Vertex AI. AutoML tampoco permite exportar modelos entrenados a otro entorno. Tu inversión en entrenamiento queda atrapada.

Nivel 4 — Integraciones: Cada conector, webhook y trigger que configuras dentro del ecosistema de Google es trabajo que se pierde si migras.

Cómo mitigar el lock-in

La estrategia que recomendamos a nuestros clientes:

- Usa la API directa de Gemini cuando sea posible, no Vertex AI, a menos que necesites fine-tuning o pipelines complejos. La API es portable — cambiar de Gemini a otro proveedor requiere solo cambiar el endpoint y adaptar el formato

- Implementa capas de abstracción entre tu aplicación y el proveedor de IA. Los servidores MCP funcionan exactamente para esto: abstraen la conexión entre tu lógica de negocio y el modelo de IA

- Mantén tus datos en formatos portables. Si usas BigQuery, exporta copias regulares en Parquet o CSV. Si entrenas modelos, documenta los datasets y parámetros para poder replicar el entrenamiento en otra plataforma

- Evalúa alternativas continuamente. Como cubrimos en nuestra guía de selección de proveedores de IA, la evaluación no es un evento único — es un proceso trimestral

Cómo evaluar si Google AI es la opción correcta para tu empresa

Antes de invertir tiempo en pruebas de concepto, responde estas cinco preguntas:

Pregunta 1: ¿Dónde viven tus datos hoy?

Si la respuesta es Google Cloud Platform — BigQuery, Cloud Storage, Firestore — el ecosistema de IA de Google es el candidato natural. La integración nativa reduce semanas de trabajo de ingeniería.

Si tus datos están en AWS, Azure, o on-premise, las ventajas de integración desaparecen. La API de Gemini sigue siendo una opción válida, pero los servicios de plataforma (Vertex AI, BigQuery ML) pierden su ventaja principal.

Pregunta 2: ¿Qué tipo de procesamiento necesitas?

- Multimodal (texto + imagen + audio + video): Google tiene ventaja. Gemini maneja esto de forma nativa.

- Solo texto con razonamiento complejo: Evalúa Claude y GPT-4 primero. Gemini está mejorando pero todavía no lidera en esta categoría.

- ML tradicional (clasificación, regresión, clustering): BigQuery ML es difícil de superar si ya estás en BigQuery.

- Extracción de documentos: Document AI es competitivo. Pero también evalúa alternativas como Amazon Textract o soluciones open source.

Pregunta 3: ¿Qué tan cómodo está tu equipo con GCP?

Las herramientas de Google requieren familiaridad con su ecosistema. IAM policies, service accounts, VPC networking, billing alerts — si tu equipo ya domina GCP, la curva de aprendizaje es mínima. Si no, suma 4-8 semanas de onboarding antes de ver resultados.

Pregunta 4: ¿Cuánta portabilidad necesitas?

Si tu empresa opera en industrias donde cambiar de proveedor de IA puede ser necesario (por regulación, costos, o estrategia), prioriza las capas 1 (API directa de Gemini) sobre las capas 2 y 3. Cada capa que agregas reduce tu capacidad de migrar.

Pregunta 5: ¿Cuál es tu timeline?

- Necesitas resultados en 2-4 semanas: API directa de Gemini con prompts bien diseñados

- Puedes invertir 1-3 meses: Vertex AI con pipelines y monitoreo

- Proyecto de 6+ meses: Soluciones verticales pre-construidas (solo si la industria y el ROI lo justifican)

Arquitectura de referencia: Google AI dentro de una estrategia multi-proveedor

La estrategia que ha funcionado mejor para nuestros clientes B2B no es elegir un solo proveedor — es usar cada proveedor donde más rinde.

Asignación por caso de uso

| Caso de uso | Proveedor recomendado | Razón |

|---|---|---|

| Procesamiento multimodal (imagen + texto + video) | Gemini Pro/Flash | Multimodalidad nativa, costo competitivo |

| Razonamiento complejo, análisis legal, redacción | Claude | Mejor seguimiento de instrucciones, razonamiento más preciso |

| Chat orientado a consumidor con plugins | GPT-4 | Ecosistema de plugins más amplio, brand recognition |

| ML sobre datos en BigQuery | BigQuery ML | Cero fricción si los datos ya están ahí |

| Extracción de documentos estructurados | Document AI o Claude | Depende del volumen y tipo de documento |

| Respuestas con datos en tiempo real | Gemini con grounding | Google Search grounding es único |

Servidores MCP como capa de abstracción

La pieza que hace viable esta estrategia multi-proveedor es una capa de abstracción entre tu aplicación y los modelos. Los servidores MCP permiten que tu aplicación se conecte a múltiples proveedores de IA a través de un protocolo estándar, sin acoplarse a ninguno.

En la práctica, esto significa que puedes:

- Cambiar de Gemini a Claude para un caso de uso sin modificar tu aplicación

- Ejecutar el mismo prompt contra múltiples modelos para comparar resultados

- Implementar fallbacks automáticos si un proveedor tiene una caída

Comparativa de costos para una carga de trabajo B2B típica

Para un caso de uso de procesamiento de ~100,000 documentos al mes con ~500 tokens promedio por documento:

| Modelo | Costo input (por 1M tokens) | Costo output (por 1M tokens) | Costo mensual estimado |

|---|---|---|---|

| Gemini Flash | $0.075 | $0.30 | ~$19 |

| Gemini Pro | $1.25 | $5.00 | ~$313 |

| Claude Haiku | $0.25 | $1.25 | ~$75 |

| Claude Sonnet | $3.00 | $15.00 | ~$900 |

| GPT-4o-mini | $0.15 | $0.60 | ~$38 |

Nota: precios aproximados a marzo 2026. Los precios varían con volumen, región y tipo de acuerdo empresarial.

El punto no es que un proveedor sea “mejor” — es que la elección correcta depende del caso de uso y el volumen. Gemini Flash para tareas de clasificación masiva. Claude Sonnet para análisis que requiere razonamiento preciso. La arquitectura multi-proveedor optimiza costos sin sacrificar calidad.

Lo que les decimos a nuestros clientes sobre Google AI

El ecosistema de IA de Google es un cajón desordenado con herramientas excelentes adentro. BigQuery ML es difícil de superar para datos tabulares en GCP. Document AI resuelve bien la extracción de documentos. Gemini Flash tiene la mejor relación costo/rendimiento para tareas de alto volumen. Y la capacidad multimodal nativa de Gemini es genuinamente diferenciadora.

Pero también les decimos lo que Google no va a decirles: el historial de estabilidad de productos genera riesgo real y el lock-in de la capa de plataforma es significativo. Aparte, el soporte empresarial todavía no está al nivel de algunos competidores.

La recomendación que más resultados ha dado: usa Google AI donde tiene ventajas claras (datos en GCP, multimodal, alto volumen), pero no apuestes todo a un solo proveedor. Una estrategia de APIs bien diseñada con capas de abstracción te da lo mejor de cada ecosistema sin quedar atrapado en ninguno.

¿Quieres evaluar cómo encaja Google AI en tu stack actual? Escríbenos para una evaluación de arquitectura multi-proveedor — analizamos tu infraestructura y tus casos de uso, y te diseñamos la combinación que optimiza resultados sin asumir riesgo innecesario.

Preguntas Frecuentes

Depende de tu infraestructura actual. Si ya operas en Google Cloud y necesitas pipelines de datos, fine-tuning y monitoreo integrado, Vertex AI tiene sentido. Si solo necesitas capacidades de generación de texto o análisis multimodal, la API directa de Gemini es más simple, más barata y te evita el lock-in con GCP.

Sí, pero con matices. La API de Gemini funciona independientemente de tu infraestructura cloud. Sin embargo, servicios como BigQuery ML, Document AI y Vertex AI Pipelines asumen que tus datos ya están en GCP. Si usas AWS o Azure, el costo de mover datos y la complejidad de operar multi-cloud pueden superar los beneficios.

Cada modelo tiene fortalezas distintas. Gemini destaca en procesamiento multimodal nativo y contextos largos (hasta 2M de tokens). Claude es fuerte en razonamiento, seguimiento de instrucciones complejas y privacidad de datos. GPT-4 tiene el ecosistema de plugins más amplio. La mejor estrategia para la mayoría de empresas B2B es multi-proveedor: usar cada modelo donde más rinde.

Es un riesgo documentado — Google ha descontinuado o renombrado múltiples productos de IA en los últimos tres años (PaLM → Gemini, Bard → Gemini, AutoML Tables → Vertex AI). Para mitigarlo, aísla las integraciones detrás de capas de abstracción, evita dependencias en features exclusivas sin alternativa, y mantén un plan de contingencia con al menos un proveedor alternativo evaluado.

Artículos Relacionados

Somos consultores de IA y a veces decimos: no uses IA

Una consultora de IA que dice 'no uses IA' suena contradictorio. Pero es lo más valioso que hacemos por nuestros clientes.

El Empleado 100x Ya Existe (Y Cambia Cómo Contratas)

Un profesional con dominio de IA produce lo que antes requería un equipo. Jensen Huang lo confirmó en GTC 2026. Así cambia tu estrategia de contratación.